Q* (Q-Star) - El supuesto gran descubrimiento de OpenAI: ¿amenaza o nada nuevo?

Recientemente, Reuters informó que investigadores de OpenAI descubrieron un avance significativo en inteligencia artificial, el cual llaman Q*.

Este supuesto desarrollo ha suscitado un intenso interés y especulación en el mundo tecnológico, no solo por sus potenciales aplicaciones, sino también por las preguntas que plantea sobre el futuro de la IA. Incluso se especula que este descubrimiento podría haber sido la causa del repentino despido de su gerente general Sam Altman hace unos días.

Sin embargo, hay varios expertos que creen que esto no sería tan crucial como algunas fuentes lo hacen parecer.

En este artículo, exploraremos qué es Q*, por qué su descubrimiento podría ser crucial para el campo de la inteligencia artificial, y criticas que están haciendo los expertos respecto a estos rumores para entender mejor el debate entorno a este tema.

¿Qué es Q-Star?

Presuntamente Q-Star combina dos conceptos ya establecidos en el campo de la Inteligencia Artificial: A* (A-Star) y Q-Learning. A continuación explicaremos en términos simples, y no tan técnicamente estrictos, que son ambos.

A* - un algoritmo de búsqueda

A* es un algoritmo de búsqueda informada que se utiliza para encontrar el camino más corto entre dos puntos en un mapa, similar a cómo una persona en un laberinto buscaría la salida.

Para lograrlo, A* combina dos conceptos importantes:

Costo hasta ahora: Esto es como mirar atrás y medir cuánto has caminado desde el punto de partida hasta donde estás ahora. En nuestro ejemplo del laberinto, sería el esfuerzo o la distancia que ya has recorrido tratando de encontrar la salida (ejemplo: la cantidad de pasos).

Estimación hasta el objetivo: Esto es como mirar hacia adelante y estimar cuánto te falta para llegar a tu destino. En el laberinto, sería tu mejor estimación sobre la distancia restante hasta la salida.

De esta manera, A-Star no solo considera la distancia que ya ha recorrido, sino también cuánto le falta por recorrer. Esto permite hacer búsquedas más rápidas y eficientes en comparación con los algoritmos que no tienen una estimación del costo.

Q-Learning - una pieza de reinforcement learning

Q-Learning es una técnica de Reinforcement Learning que permite que los agentes, como un robot o un programa de software, aprendan a tomar decisiones óptimas basándose en su experiencia dentro de un entorno específico, sin un mapa o una guía previa.

Para ilustrar, imagina que te encuentras en un laberinto sin un mapa. Cada vez que tomas una decisión sobre hacia dónde ir, recibes una pista: "frío" si estás más lejos, o "caliente" si estás más cerca. Con el tiempo, aprendes qué decisiones te llevan más cerca de la salida en base a las pistas que te han dado.

En Q-Learning, se mantiene un registro de las "recompensas" que se obtienen al tomar ciertas acciones en diferentes estados. Por ejemplo, en nuestro laberinto, cada intersección sería un "estado" y cada posible dirección que podrías tomar sería una "acción".

Las recompensas se actualizan continuamente a medida que se explora el laberinto y se aprende de la experiencia. En el ejemplo anterior, el registro contendría todos los posibles resultados de "frío" y "caliente" que conocemos y ayudaría a priorizar los más "calientes" para así maximizar nuestras posibilidades de salir del laberinto.

Si quieres aprender más sobre la parte técnica de estos conceptos, revisa el curso de Harvard de CS50 de Inteligencia Artificial. En particular, en la clase 0 se revisa A*, y en la clase 4 se revisa Q-Learning.

Relación entre A* y Q-Learning

Aunque A* y Q-Learning difieren en su enfoque, ambos juegan un papel crucial en la toma de decisiones automatizada, optimizando procesos en distintos contextos. A* se usa en entornos conocidos, y Q-Learning en entornos desconocidos o dinámicos donde se requiere aprendizaje y adaptación.

Se especula que Q-Star una mezcla entre ambos, que abriría importantes avances.

¿Por qué estos avances serían tan importantes?

La matemática y otras operaciones lógicas son muy desafiantes para ChatGPT y otros modelos similares. De ser cierto, Q-Star podría ser un gran paso para solucionar esto.

Los grandes modelos de lenguaje auto-regresivos (AR-LLM, por sus siglas en inglés) - la principal tecnología detrás de ChatGPT, Bard y otros de los modelos más populares de este tiempo - son muy buenos en predecir cual es la siguiente palabra en un texto dado las frases anteriores.

Por ejemplo, si te pido que completes la frase:

Al mal tiempo, buena ___

Lo más probable es que sepas la respuesta debido a la popularidad del dicho "Al mal tiempo, buena cara", pero lógicamente hubiesen caído ahí también otras palabras como "actitud", "disposición", entre otros. Los AR-LLM son particularmente buenos distinguiendo cual palabra debe ir ahí, y con otras tareas relacionadas al lenguaje.

Sin embargo estos modelos no hacen todo bien. Los LLMs son particularmente malos para resolver tareas donde sólo hay una respuesta, incluyendo los cálculos matemáticos.

Por ejemplo en la siguiente imagen pueden ver una multiplicación que le pedí a ChatGPT y su respuesta, la cual no concuerda con el resultado real. A esto se le conoce una alucinación.

¿Existe alguna manera de solucionar esto y así permitir que modelos como ChatGPT sean buenos en el lenguaje pero también en las tareas lógicas?

Para lograr esto, varios laboratorios de Inteligencia Artificial han intentado avanzar en distintos métodos. Q-Star sería la manera en que OpenAI habría resuelto el problema.

Las supuestas implicancias de Q*

Si Q-Star realmente funciona como se especula, podría revolucionar tecnologías como ChatGPT, mejorando significativamente su capacidad para realizar tareas lógicas, como cálculos matemáticos.

Este avance potencialmente le otorgaría a la IA un grado superior de autonomía, permitiéndole navegar y ejecutar de manera independiente las acciones necesarias para completar diversas tareas. Actualmente, las limitaciones de la IA incluyen problemas como las 'alucinaciones', es decir, errores en la generación de respuestas, y una gestión deficiente de la memoria a largo plazo, lo que no permite que puedan ser tan autonomas.

El artículo de Reuters menciona lo siguiente

El nuevo modelo pudo resolver ciertos problemas matemáticos, dijo la persona bajo condición de anonimato porque no estaba autorizada a hablar en nombre de la empresa. Aunque solo realizaba matemáticas al nivel de los estudiantes de escuela primaria, superar esas pruebas hizo que los investigadores se sintieran muy optimistas sobre el éxito futuro de Q*, dijo la fuente.

Si se confirma, esto sería un avance hacia la alcanzar la Inteligencia Artificial General (o AGI, por su siglas en inglés) o también conocida como Inteligencia Artificial Fuerte, la cual es la IA que iguala o supera la capacidad intelectual humana.

Especulaciones y criticas

La aparición de Q* ha generado una amplia gama de especulaciones y debates en la comunidad científica y tecnológica.

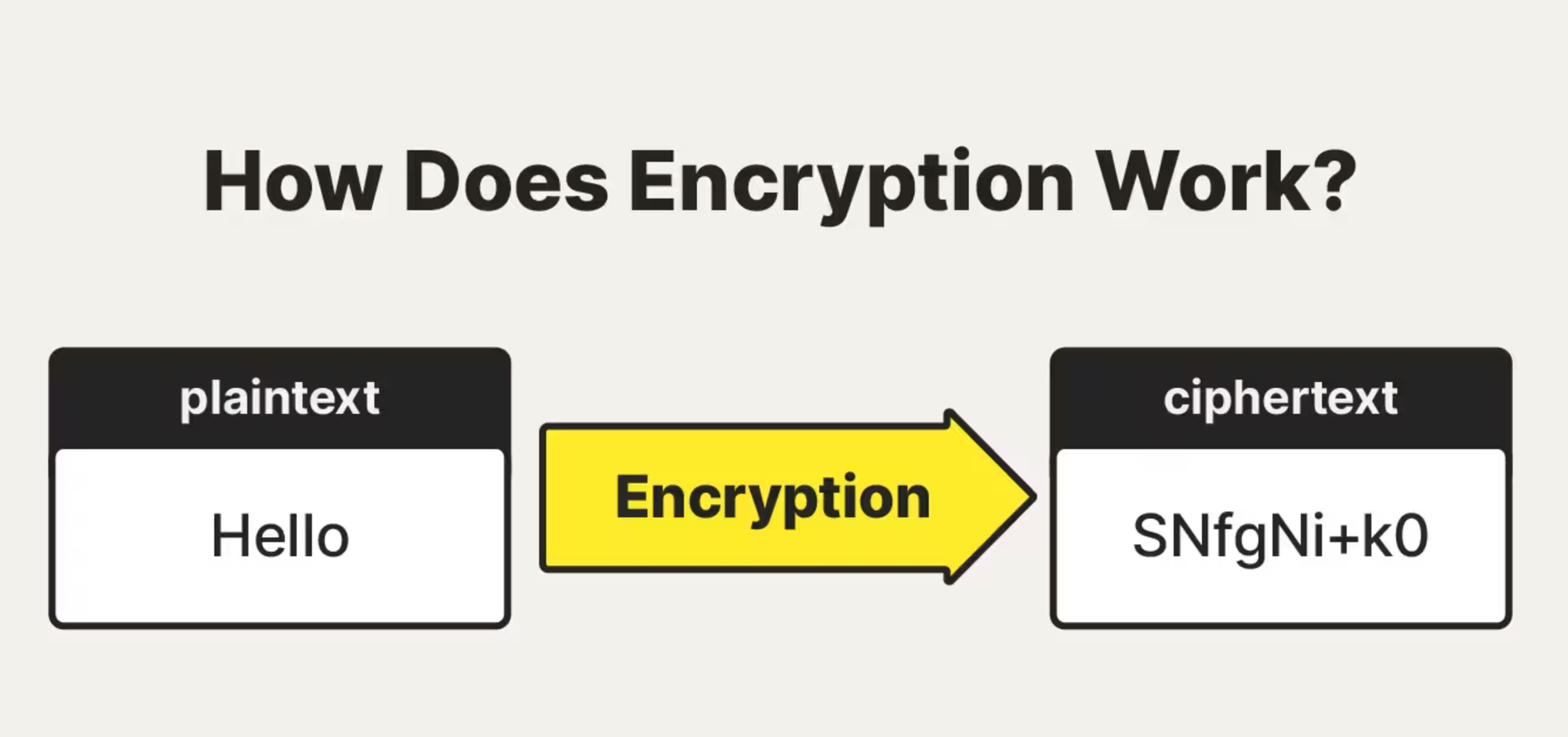

Podría romper la encriptación

Entre las especulaciones más intrigantes está la posibilidad de que Q-Star tenga la capacidad de descifrar algoritmos de encriptación, un avance que tendría profundas implicaciones en la seguridad cibernética.

La encriptación, que convierte la información en un formato ilegible para protegerla de accesos no autorizados, es un pilar fundamental de la seguridad digital actual.

La presunta habilidad de Q-Star de razonar y hacer cálculos matemáticos le permitiría encontrar la manera de romper la matemática detrás de la encriptación y así poder decodificar lo que está encriptado.

Actualmente la encriptación es la base de la ciberseguridad, es la razón por la cual no es fácil entrar a tus cuentas, leer tus mensajes de WhatsApp, hacer pagos electrónicos y más.

Podría ser la razón de la crisis en OpenAI

Se rumorea que existió una carta escrita por empleados de OpenAI al directorio donde advertían sobre un nuevo avance de la IA con consecuencias potencialmente nefastas para la humanidad.

Se presume que esto podría haber sido la razón gatillante del sorpresivo despido de su gerente general Sam Altman. Después de un montón de otros eventos, Sam Altman finalmente regresó pero el directorio cambió casi completamente.

Revisa más detalles sobre esta crisis en nuestro podcast.

Varios expertos son escépticos al respecto

Personalidades destacadas en el campo de la IA, como Yann LeCun de Meta, han manifestado dudas sobre la verdadera innovación y relevancia del proyecto Q* de OpenAI, cuestionando su impacto real en el avance de la tecnología.

Please ignore the deluge of complete nonsense about Q*.

— Yann LeCun (@ylecun) November 24, 2023

One of the main challenges to improve LLM reliability is to replace Auto-Regressive token prediction with planning.

Pretty much every top lab (FAIR, DeepMind, OpenAI etc) is working on that and some have already published…

Tweet de Yann LeCun, líder de IA de Meta, que comienza como "Por favor, ignore la avalancha de tonterías sin sentido sobre Q*"

LeCun y otros investigadores cuestionan si realmente representa un gran avance o simplemente una extensión de trabajos en curso.

Nathan Lambert, del Allen Institute for AI, compartió este artículo donde señala que esto sería "un salto mucho menor al que se asume" por las informaciones en la prensa.

Además todo lo mencionado respecto a Q-Star hasta el momento es altamente especulativo. La carta de OpenAI no ha sido liberada al publico, y algunos incluso cuestionan su real existencia y de la seriedad de Reuters como fuente.

Por ejemplo, John Atkinson-Abutridy, académico de la Universidad Adolfo Ibáñez mostró en LinkedIn varios ejemplos de distintos medios que han caído en "la falta de rigurosidad investigativa optando por lo fácil", respecto a este y otros temas relacionados a la IA.

Incluso otros expertos han señalado que Q* no es un concepto nuevo, mencionando su presencia en los registros de OpenAI desde hace años. En este vídeo del 2016, John Schulman, cofundador de OpenAI, dio una charla donde se refería a "Q*" sólo como un nombre de un valor que maximizaba una función.

Conclusion

De ser ciertos los rumores, Q-Star podría ser un paso adelante en la búsqueda de una Inteligencia Artificial General, capaz de realizar tareas con un nivel de comprensión y autonomía que actualmente parece lejano a través de mezclar lo que actualmente hacen bien los LLMs con las capacidades matemáticas que actualmente carecen.

Sin embargo, un halo de misterio/desinformación aún envuelve esta iniciativa. Esto hace imposible dar una respuesta clara a qué realmente es Q* y su verdadero impacto. Muchos expertos han criticado la especulación de los medios al respecto, la novedad y el potencial alcance de un descubrimiento así.

Personalmente, creo que muchos medios y los denominados 'pesimistas de la IA' (AI doomists) están generando falsas expectativas. Esto resulta más sencillo debido a que los conceptos subyacentes a Q*: A-Star y Q-Learning pueden ser difíciles de comprender para aquellos que no están familiarizados con los aspectos técnicos de los algoritmos. Después de entender más de esos dos conceptos es fácil preguntarse ¿qué es lo nuevo? ¿qué es lo potente de este descubrimiento?

Además, esta dificultad técnica contribuye a crear una narrativa más atractiva para explicar la crisis en OpenAI, cuyas causas, al momento de escribir este post, aún no están claras. Exagerar el impacto de Q-Star resulta en más visualizaciones y visitas. En contraste, los argumentos basados en la ciencia suelen ser percibidos como aburridos o demasiado complejos para el público general.

Esperamos que este artículo te haya dado un mejor entendimiento del debate actual.

Escrito por Sebastián Cisterna para EvoAcademy